Introducción

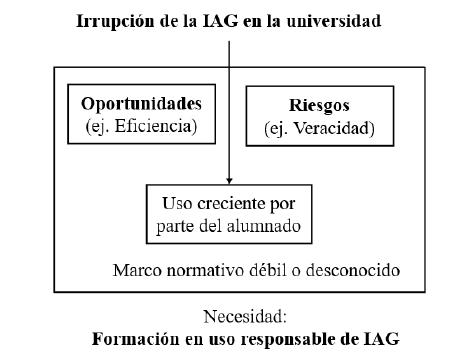

La adopción de la Inteligencia Artificial (IA), y en concreto de la Inteligencia Artificial Generativa (IAG) como ChatGPT (OpenAI), en educación superior, está cambiando drásticamente tanto el acceso al conocimiento como las metodologías docentes (Cruz-Argudo et al., 2023). Estas tecnologías ofrecen un nuevo paradigma para el aprendizaje lleno de oportunidades, donde destacan la personalización y la mejora de la eficiencia (Adeshola et al., 2023), pero también plantean desafíos éticos relacionados con la autoría, la veracidad de la información, la privacidad o la integridad académica, que convienen ser abordados por la comunidad educativa (Blahopoulou & Ortiz-Bonnin, 2025; Lopes et al., 2024).

Aunque las instituciones de educación han comenzado a desarrollar normativas y orientaciones para guiar en el uso de la IAG, estás iniciativas no garantizan por sí solas una comprensión crítica por parte de la comunidad (Bendixen et al., 2024). En la práctica, se observa una disociación entre la expansión de herramientas de IAG y la alfabetización ética sobre el empleo de éstas en el ámbito académico. Investigaciones recientes evidencian que la mayoría de alumnado usa la IAG para tareas académicas (Blahopoulou & Ortiz, 2025), pero sin conocer de forma adecuada cuáles son los límites normativos o los riesgos asociados a su uso, como son los sesgos algorítmicos, las alucinaciones o la delegación no crítica de funciones cognitivas esenciales para el aprendizaje (Chen et al., 2025; Bergström et al., 2024; Farrokhnia et al., 2023). Por tanto, esta desconexión destaca la necesidad de desarrollar intervenciones formativas que no sólo informen, sino que promuevan una reflexión crítica sobre el uso de estas tecnologías (Figura 1).

Este trabajo aporta un enfoque novedoso al presentar, analizar y evaluar empíricamente una intervención formativa centrada en el uso ético de la IAG en el contexto universitario. En este contexto, el presente trabajo tiene los siguientes objetivos:

Objetivo 1: Presentar el diseño (contenidos y actividades) de un taller sobre el uso responsable de la IA dirigido al alumnado universitario en el ámbito académico, desarrollado en el marco de un proyecto de innovación docente.

Objetivo 2: Evaluar la satisfacción del alumnado con el taller.

Objetivo 3: Analizar el interés por recibir formación futura sobre IA, y los contenidos específicos que desearían abordar a través de información cualitativa.

Marcos normativo internacional y nacional

En cuanto a la normativa disponible, los distintos marcos normativos internacionales destacan de forma clara que, en primer lugar, el desarrollo y despliegue de la IAG debe estar supervisado por humanos, y, en segundo lugar, la importancia de una alfabetización ética en el uso de la IA que enfatice valores cruciales como son el respecto a los derechos humanos, la dignidad, la equidad, la no discriminación o la transparencia (Agyemang-Badu et al., 2024). En concreto, las recomendaciones más recientes de la UNESCO sobre el uso de la IA se apoyan en el consenso de Beijing (UNESCO, 2019), en el que se destaca la importancia de la integración ética de la IAG en educación y donde se proponen criterios clave para su implementación. En paralelo, la Unión Europea también ha desarrollado directrices y reglamentos orientados a garantizar el uso legal, ético y robusto de la IA (Comisión Europea, 2021). En el ámbito Español el Instituto Nacional de Tecnologías Educativas y de Formación del Profesorado (INTEF) creó una guía sobre el uso de la IAG en el ámbito educativo, haciendo especial hincapié en abordar la ética y la IAG con el alumnado (INTEF, 2024). Por tanto, estos marcos normativos constituyen los fundamentos sólidos desde los que diseñar programas educativos universitarios que fomenten el uso responsable de estas tecnologías. Además, se encuentra legitimada la inclusión del uso responsable de la IA en los planes de estudio, tanto desde una perspectiva normativa como pedagógica (UNESCO, 2024).

Iniciativas institucionales en universidades españolas

Desde las Universidades Españolas, la Conferencia de Rectores (CRUE, 2024) ha promovido, en los últimos años, talleres y jornadas sobre IAG en educación superior, evidenciando el interés institucional por estas temáticas (CRUE, 2023). En concreto, se han comenzado a implementar iniciativas institucionales para regular el uso ético de la IAG en el ámbito académico. Varias universidades españolas han publicado guías y documentos con declaraciones y recomendaciones para un uso responsable, algunas de ellas, aún en fases incipientes, y que se recogen en la Tabla 1.

Tabla 1 Iniciativa institucional sobre el uso de la IA en Universidades españolas

| Universidad | Año | Documento/Acción principal | Enfoque destacado |

|---|---|---|---|

| Universidad Internacional de La Rioja (UNIR) | 2023 | Declaración institucional de 10 principios sobre IA | Uso justo, seguro y transparente; difusión UNESCO |

| Universidad Carlos III de Madrid (UC3M) | 2023 | Guía sobre IA generativa en docencia | Uso crítico y responsable por parte del estudiantado |

| Universidad de Granada (UGR) | 2024 | Recomendaciones participativas sobre IA | Buenas prácticas, riesgos y oportunidades en docencia, investigación y gestión |

| Universidad de Deusto | 2024 | Posicionamiento institucional sobre IA | Valores humanistas y derechos digitales |

| Universidad de Cádiz (UCA) | 2025 | Guía para docentes e investigadores sobre IA generativa | Marco ético alineado con legislación europea y nacional |

| Universidad Pontificia Comillas | 2025 | Orientaciones prácticas para toda la comunidad universitaria | Normas claras sobre citación, uso pedagógico y supervisión humana |

| Universidad de Málaga (UMA) | 2025 | Orientaciones prácticas para la comunidad universitaria | Guía oficial sobre el uso de la IA en el ámbito académico |

Fuente: Elaboración propia.

Estas acciones reflejan el compromiso por parte de las universidades de establecer unas normas de uso y en la regulación ética de la IAG en educación superior. Evidenciando una respuesta normativa creciente, pero aún insuficiente, para consolidar una auténtica cultura institucional sobre el uso ético de la IAG. En concreto, varias universidades han emitido declaraciones sobre el uso de la IAG, pero la implementación de actividades formativas sigue siendo desigual. Por ejemplo, la Universidad de Murcia, en colaboración con EUniWell (Universidad Europea para el Bienestar), han impulsado talleres online dirigidos tanto a estudiantes como a personal docente, centrados en ética, bienestar y competencias digitales (UMU, 2023). También destaca la alfabetización en relación con el uso de la IAG en educación que se lleva a cabo desde la iniciativa #YosigoUGR desde la Universidad de Granada (UGR, 2025). Estas experiencias han sido reconocidas por su capacidad para promover una cultura de integridad y uso responsable de la IAG entre los participantes y representan modelos replicables por otras universidades en el espacio europeo. Mientras que en países europeos se ha comenzado a institucionalizar módulos obligatorios sobre ética digital e IAG responsable (Ansari et al., 2024).

Necesidad formativa ante el avance de la IA en el ámbito universitario

Tal y como se ha mencionado con anterioridad, en España, a pesar de la proliferación normativa y las respuestas institucionales, persiste una preocupante brecha entre el uso extendido de la IAG por parte del estudiantado y la comprensión profunda de las implicaciones éticas y las políticas vigentes (Chen et al., 2025). Es decir, muchos todavía no comprenden las oportunidades y los riesgos asociados a su uso (Chen et al., 2024). Estas carencias pueden tener consecuencias graves, ya que, sin una formación adecuada, el alumnado puede estar usando herramientas de IAG de manera inadecuada, sin entender los riesgos asociados a la desinformación, la delegación acrítica de tareas o el uso de contenidos sesgados y erróneos. Además, a ello se suma una falsa percepción de neutralidad tecnológica, que invisibiliza los marcos ideológicos que modelan los sistemas de IA (Bergström et al., 2024).

Otro aspecto importante a considerar es que la deshonestidad académica sigue siendo una preocupación persistente para las instituciones educativas, amenazando la reputación universitaria, y la aparición de Internet y ahora herramientas de IAG, como ChatGPT, intensifican este desafío (Bin-Nashwan et al., 2023; Cerdà-Navarro et al., 2025; Comas-Forgas & Sureda, 2008). La introducción de la IAG está difuminando las líneas tradicionales entre el uso aceptable de herramientas de apoyo y la deshonestidad académica (Bergström et al., 2024; Premat & Farazouli, 2025). Por su parte, Bergström et al. (2024) desarrollaron una escala para medir percepciones y conductas en torno al uso de una IAG (ChatGPT), e identificaron perfiles de estudiantes que, pese a tener actitudes positivas sobre su educación, no conocían las implicaciones éticas básicas. En concreto, encontraron que la percepción estudiantil sobre la gravedad de diferentes usos de la IAG varía significativamente: mientras que copiar respuestas en un examen con IAG se considera mayoritariamente inaceptable, utilizarla para mejorar la redacción o generar ideas iniciales recibe una valoración mucho más laxa (Bergström et al., 2024). Esta ambigüedad percibida resalta la necesidad de directrices claras y de programas formativos que se enfoquen tanto en el uso responsable de la IAG como en el fomento de la integridad académica, basados en valores como el respeto, el valor de la autoría o la honestidad (Chen et al., 2024; Vallespir-Adillón et al., 2024).

También, estudios recientes muestran que la percepción de riesgo asociada al uso de estas herramientas influye en la frecuencia y la intención de su uso por parte de estudiantes. Aquellos con una mayor percepción de la gravedad de la deshonestidad académica presentan también un mayor reconocimiento de los riesgos del uso de ChatGPT, lo que se traduce en un uso más limitado de la herramienta. Estos hallazgos señalan la importancia de integrar la IAG en la educación superior de manera ética y reflexiva, considerando no solo sus ventajas para el aprendizaje personalizado y el acceso a la información, sino también, enseñando sobre los riesgos asociados, como la generación de información inexacta y el plagio (Ortiz & Blahopoulou, 2025).

Además, la demanda de formación específica sobre el uso responsable de herramientas de IAG por parte del alumnado es evidente y urgente. En una investigación en la que participaron más de 700 estudiantes de diversos grados de la Universidad de las Islas Baleares, se confirmó que el interés por recibir este tipo de formación es significativo (Blahopoulou & Ortiz, 2024). Concretamente, un 39 % de los participantes expresaron su disposición a inscribirse en un taller enfocado en el uso ético de herramientas de IAG. Estos resultados reflejan una necesidad y motivación entre el estudiantado por adquirir competencias que les permitan manejar la IAG de manera ética y responsable, por lo que se justifica la implementación de talleres formativos adaptados a esta demanda.

Diseño del taller

El taller que aquí se presenta se desarrolló de forma presencial, teniendo en cuenta las necesidades específicas de sus participantes. Según la literatura, los talleres sobre ética e IAG deben incorporar cuatro características clave - interactividad, contextualización, co-construcción del conocimiento y evaluación formativa -, recomendaciones que fueron tenidas en cuenta en el diseño y desarrollo de la actividad (CRUE, 2023; Fernández-Mármol, 2024). En concreto, el taller fue diseñado y realizado por miembros del equipo de investigación en el marco de un Proyecto de Innovación y Mejora de la Calidad Docente 2024-2026 de la Universidad de las Islas Baleares, titulado "Una propuesta para integrar la Inteligencia Artificial en la universidad, fomentar un uso ético y responsable, y potenciar la futura empleabilidad del alumnado" (PID242647), financiado por el Instituto de Investigación e Innovación Educativa (IRIE). La metodología de enseñanza era mixta, incluyendo presentación de datos y definiciones, así como, la inclusión de ejercicios prácticos tanto a nivel individual, como por parejas y en grupos. Además, se incorporaron elementos de gamificación para fomentar la participación activa y el compromiso del alumnado.

La mayoría de los trabajos sobre intervenciones ofrecen escasa información respecto a su contenido. Así, con el objetivo de garantizar una mayor transparencia del trabajo realizado, favorecer la replicación de este y permitir una evaluación más clara de los resultados, a continuación, se presentan tanto los temas tratados en la formación como la metodología de enseñanza seguidas.

Objetivos del taller

El taller abordó los siguientes objetivos: 1) mostrar que es la IAG, qué la caracteriza y qué herramientas existen en la actualidad; 2) promover la reflexión sobre como la IAG transformará el aprendizaje universitario y la futura vida laboral; 3) informar sobre las oportunidades y los riesgos asociados al uso de la IAG; 4) sensibilizar al alumnado sobre la importancia de un uso responsable y ético; 5) fomentar la integridad académica del alumnado.

Contenidos y estructura del taller

El taller constaba de seis partes en las que se abordaron diferentes contenidos a través de diversas metodologías docentes. La Tabla 2 resume la estructura y dinámica del taller.

Tabla 2 Estructura y dinámica del taller “Uso responsable de la IA”

| Parte del taller | Contenido principal | Dinámicas |

|---|---|---|

| 1. Introducción | Presentación del índice de contenidos. Visualización y análisis de un vídeo publicitario sobre IA. | Debate guiado a partir del vídeo; preguntas de reflexión grupal. |

| 2. Conceptos clave | Definición de IA e IAG; ejemplos de herramientas como ChatGPT, Claude o Gemini. | Exposición breve y encuesta de uso de la IA en directo mediante la aplicación Mentimeter. |

| 3. Aplicación de la teoría a la práctica | Preguntas clave sobre el impacto de la IA en el aprendizaje y la vida laboral. | Trabajo en grupos pequeños y puesta en común. |

| 4. Oportunidades y riesgos de la IA | Identificación de oportunidades y riesgos como la deshonestidad académica a partir de afirmaciones. | Dinámica de votación (cartulinas rojo/verde) y diálogo argumentado. |

| 5. Conclusiones | Elaboración de normas de uso de IA pensadas por el propio alumnado. | Trabajo por parejas y discusión grupal. |

| 6. Cierre | Recomendaciones finales. | Exposición final por parte de la formadora. |

Fuente: Elaboración propia.

Primera parte - Introducción

El taller “Uso responsable de la Inteligencia Artificial” comienza con una introducción de los contenidos que se abordarán a lo largo de la sesión: 1) ¿Qué es la IA? 2) Reflexiones sobre el presente y el futuro con IA. 3) Oportunidades y riesgos de la IA. 4) Principales conclusiones. Para comenzar el taller, se visualizó un video publicitario. En este anuncio, vemos algo poco habitual: el propio director aparece dentro del mismo anuncio reconociendo que la primera versión fue generada por una IA. A pesar de su calidad técnica, el director comenta que no está satisfecho con el resultado. A medida que avanza el video, va señalando aspectos que le parecen poco auténticos o genéricos, como la falta de diversidad en las personas que aparecen o la manera superficial en la que se transmite el mensaje. Entonces, decide intervenir y hacer cambios: elige actores más diversos, ajusta el guion y modifica escenas. En definitiva, personaliza el contenido para que sea más real, más humano y representativo. Este video sirve como punto de partida para reflexionar sobre el papel de la IA en la creación de contenidos, pero también sobre el valor de la intervención humana: el juicio crítico, la creatividad y la capacidad de contextualizar (ver vídeo: https://www.youtube.com/watch?v=VpJ79WLl0JA).

Para fomentar un análisis en grupo y estimular la discusión, se hicieron una serie de preguntas a la clase sobre el video. Estas preguntas tenían como objetivo romper el hielo y profundizar en su contenido. Estas preguntas buscan que los participantes reflexionen y discutan sobre el mensaje que transmite el video, promoviendo un debate más profundo y una comprensión más completa de la relación entre la IA y la intervención humana en el trabajo académico.

Finalmente, se utiliza este anuncio como un símil con el trabajo académico. Al igual que en el anuncio, no es lo mismo usar la IAG como una herramienta para la generación de ideas, con la que ayudar o inspirar, que dejarla hacer todo el trabajo. En el ámbito académico, es fundamental mantener una participación activa, personal y reflexiva por ejemplo en la producción de textos. El propósito de esta sección es destacar que la IAG puede actuar como un recurso de apoyo, pero el análisis, la expresión y la responsabilidad deben continuar siendo ejercidos por los seres humanos.

Segunda parte - Conceptos clave

En este parte se presentaba una definición general de IA, con especial énfasis en la IAG, y se explican conceptos clave como LLM (Large Language Model) y GPT (Generative Pre-trained Transformer). Se introducen también otras herramientas de IAG además de ChatGPT, como Claude o Gemini. Esta sección incluye un breve repaso histórico de los avances tecnológicos, con el mensaje de que los seres humanos han sabido adaptarse y beneficiarse de cada revolución tecnológica. La parte final de esta sección consistía en una encuesta anónima en vivo, realizada a través de Mentimeter, en la que se preguntaba al alumnado para qué utiliza la IAG. Los resultados se proyectan y se comentan de forma general con el grupo.

Tercera parte - Reflexión grupal: Aplicación de la teoría a la práctica

En esta sección, el alumnado se organizaba en grupos de cuatro personas para reflexionar sobre dos preguntas clave: “¿Cómo está cambiando y cambiará la IA nuestra forma de aprender?” y “¿Cómo está afectando y afectará la IA a mi futuro trabajo?”. Tras un tiempo de trabajo en grupo, se ponen en común los resultados. Cada grupo tiene, además, la posibilidad de compartir oralmente sus conclusiones con la clase y la formadora.

Cuarta parte - Oportunidades y Riesgos de la IA

A continuación, se realizó una dinámica basada en la gamificación, en la que el alumnado debía localizar siete sobres numerados, previamente escondidos en diferentes puntos del aula. La colocación oculta de los sobres funcionó como una metáfora, simbolizando cómo los riesgos, mitos o percepciones erróneas en torno al uso de la IAG en el ámbito educativo a menudo permanecen “escondidos” o poco visibles. Una vez localizados los sobres, una persona de cada grupo leía en voz alta la afirmación contenida en su interior. Estas frases reflejaban distintos puntos de vista sobre el uso de la IAG en el ámbito educativo, incluyendo tanto oportunidades (por ejemplo, “la IA puede ayudarme a redactar mejor y corregir mis faltas de ortografía” o “la IA puede ayudarme a comprender mejor las asignaturas y resolver mis dudas”), como riesgos potenciales (por ejemplo, “la IA puede generar injusticas entre el alumnado”). Además, se plantearon afirmaciones vinculadas a otros temas relevantes, como la pérdida de creatividad, el fomento del plagio, la privacidad y la protección de datos, así como beneficios asociados al ahorro de tiempo y la automatización de tareas repetitivas.

Inmediatamente después de la lectura, el resto de la clase debía votar si consideraba que la afirmación era verdadera o falsa, levantando cartulinas verdes (si creían que era verdadera) o rojas (si creían que era falsa). Estas cartulinas se repartieron antes de empezar la actividad. Tras la votación, se compartía información relevante relacionada con el contenido del sobre y se abría un espacio al diálogo en el que el alumnado explicaba los motivos de su elección y reflexionaba colectivamente sobre si la afirmación planteaba una oportunidad o un riesgo en el uso de la IAG. Con esta dinámica se pretendía desmitificar ideas como que la IAG siempre ofrece datos verídicos y contrastados (alucinaciones) y sensibilizar sobre el peligro de que el uso de IAG potencie el plagio.

Quinta parte - Conclusiones

En este punto del taller se proponía una dinámica que fomentaba el pensamiento crítico del alumnado. En parejas, debían responder a la siguiente pregunta: “Si tuvieras que definir una política de uso de IAG en la universidad, ¿cuáles serían las tres reglas esenciales para garantizar un uso seguro, ético y justo?”. Esta actividad buscaba estimular la reflexión en torno a los beneficios, riesgos y complejidades del uso de la IAG en el entorno académico.

Sexta parte - Cierre

Para finalizar el taller, se compartían tres recomendaciones finales:

El ser humano es el responsable del uso de la IAG (Arnestad, et al., 2024)

La IAG es una aliada que acompaña en el aprendizaje y el trabajo (Zhang, 2025).

“Si usas IA, hazlo bien” (Khyati Sundaram, CEO de Applied)

Al final del taller se le proporcionó acceso al alumnado (a través de la plataforma online de la asignatura en cuestión) a un documento que contenía la presentación del taller con todos los conceptos trabajados durante la sesión.

Implementación del taller

Procedimiento

Durante el curso académico 2024/25 se realizaron cuatro talleres en la Universidad de las Islas Baleares, con la misma estructura desarrollada en el apartado anterior. En estos talleres participaron estudiantes de distintos títulos universitarios. Cada taller tenía una duración de dos horas y se llevó a cabo durante una sesión de prácticas de una asignatura concreta. La actividad se llevó a cabo en las asignaturas donde las investigadoras principales del proyecto tenían docencia, en concreto, en los grados de Trabajo Social, Relaciones Laborales, Dirección Hotelera y Derecho de la Universidad de las Islas Baleares. Al final de cada taller el alumnado contestó el cuestionario de evaluación para valorar las características del taller de forma voluntaria y anónima. En todos los casos, las personas participantes fueron tratadas respetando estrictamente las normas éticas al uso para realizar una investigación. Este trabajo cumple con los principios éticos que propone APA en relación con la investigación con seres humanos. El estudio recibió la aprobación ética del Comité de Ética de la Investigación de la Universidad de las Islas Baleares (CER), con el número de aprobación 353CER23, el 21 de septiembre de 2023, antes de la recolección de datos, y todos los participantes dieron su consentimiento informado antes de participar en el estudio.

Participantes

En los cuatro talleres participaron un total de 140 estudiantes, aproximadamente 30 por grupo. Al finalizar la actividad, se recopilaron datos sociodemográficos, incluyendo el género, la titulación y el curso más alto en el que se encontraban matriculados. La Tabla 3, recoge los datos sociodemográficos de los participantes.

Tabla 3 Descripción de la muestra (n = 140)

| Frecuencia | Porcentaje | |

|---|---|---|

| Género | ||

| Masculino | 32 | 27.4% |

| Femenino | 85 | 72.6% |

| Sin respuesta | 23 | 16.4% |

| Estudios | ||

| Trabajo social | 59 | 42.1% |

| Dirección hotelera | 36 | 25.7% |

| Relaciones laborales | 24 | 17.1% |

| Derecho | 18 | 12.9% |

| Turismo | 1 | 0.7% |

| Otros | 2 | 1.4% |

| Curso académico | ||

| Primero | 81 | 57.9% |

| Tercero | 53 | 37.9% |

| Cuarto | 4 | 2.9% |

| Quinto | 2 | 1.4% |

Fuente: Elaboración propia.

Instrumentos para la recogida de datos

El cuestionario empleado para la evaluación del taller fue elaborado por miembros del equipo de investigación y está constituido por catorce ítems. Los/as participantes podían valorar distintas características de la formación (realización de actividades, relevancia de los contenidos, utilidad del material de apoyo, satisfacción general, etc.) mediante una escala tipo Likert de cinco valores siendo 1 (nada de acuerdo) a 5 (totalmente de acuerdo). Un ejemplo de ítem es: “La presentación y los objetivos del taller fueron claros desde el inicio”. Esta escala, ya ha sido utilizada previamente por Blahopoulou et al. (2024), demostrando una alta fiabilidad interna en este estudio (α = .92; ω = .93).

El estudiantado respondió también a dos preguntas, con el objetivo de conocer los intereses formativos del alumnado: ¿Tienes pensado hacer algún curso sobre IAG?, ¿Qué te gustaría aprender en otro taller sobre IAG?

Análisis de datos

A partir del procedimiento descrito recogieron datos sobre la valoración del taller de parte de los participantes. En primer lugar, se analizaron las métricas descriptivas de cada uno de los ítems. En segundo lugar, se creó una variable que representaba la media de todos los ítems de evaluación del taller, para la cual también se calculó la media y la desviación estándar. Por último, se analizaron las frecuencias para evaluar cuántas personas habían valorado con la puntuación máxima cada uno de los ítems de la escala que evaluaba el taller.

Resultados

Evaluación de la satisfacción del alumnado con el taller

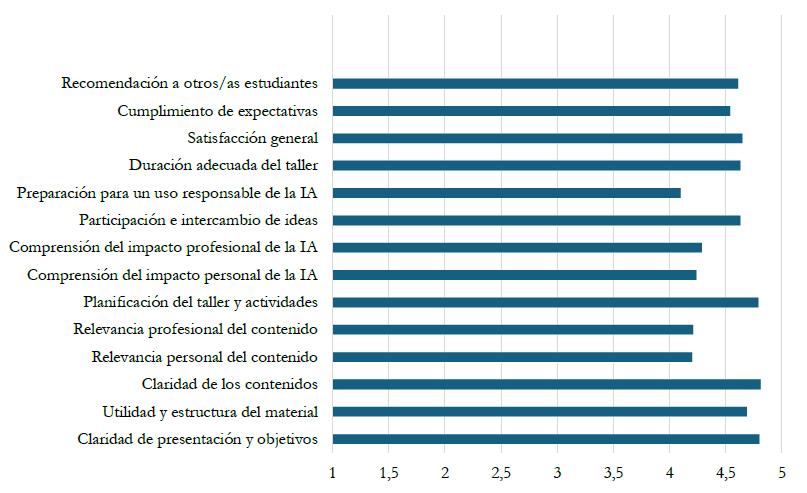

En general, el análisis de los resultados cuantitativos muestra que el alumnado valoró muy positivamente el taller (Tabla 4 y Figura 2).

Tabla 4 Valoración del taller por parte del alumnado

| Ítems de satisfacción con el taller | Media | Desviación típica |

|---|---|---|

| 1. La presentación y los objetivos del taller fueron claros desde el inicio. | 4.80 | 0.53 |

| 2. El material de apoyo fue útil y bien estructurado. | 4.69 | 0.59 |

| 3. Los contenidos fueron presentados con claridad. | 4.81 | 0.46 |

| 4. El contenido del taller ha sido relevante y útil para mi desarrollo personal. | 4.2 | 0.92 |

| 5. El contenido del taller ha sido relevante y útil para mi desarrollo profesional. | 4.21 | 0.90 |

| 6. El taller y sus actividades han sido preparados y planificados adecuadamente. | 4.79 | 0.46 |

| 7. El taller me ha ayudado a entender mejor la IA y cómo afecta ésta a mi vida personal. | 4.24 | 0.93 |

| 8. El taller me ha ayudado a entender mejor la IA y cómo afecta ésta a mi vida profesional. | 4.29 | 0.91 |

| 9. El taller fomentó la participación activa y el intercambio de ideas. | 4.63 | 0.72 |

| 10. Me siento más preparado/a para utilizar la IA de manera correcta y responsable después de este taller. | 4.1 | 0.93 |

| 11. La duración del taller fue adecuada para cubrir los temas presentados. | 4.63 | 0.62 |

| 12. En general, estoy satisfecho/a con el taller. | 4.65 | 0.68 |

| 13. El taller ha cumplido con mis expectativas. | 4.54 | 0.77 |

| 14. Recomendaría este taller a otros/as estudiantes. | 4.61 | 0.72 |

| Satisfacción total (media de los ítems) | 4.51 | 0.52 |

Fuente: Elaboración propia.

En concreto, el ítem que obtuvo la puntuación más alta hace referencia a la claridad con la que fueron explicados los contenidos (M = 4. 81; SD = 0.53). El alumnado ha evaluado con puntuaciones muy similares, los ítems 1, 2 y 6, que hacen referencia a que desde el inicio se presentaron los objetivos del taller (M = 4.80, SD = 0.50), la preparación y planificación de las actividades (M = 4.79, SD = 0.46), y la utilidad del material de apoyo (M = 4.69, SD = 0.59). Además, la gran mayoría mostraron una alta satisfacción con el taller a nivel general (M= 4.51; SD= 0.52) y también declararon recomendarlo a otros/as estudiantes (M= 4.61; SD= 0.80).

Análisis del interés en formación futura sobre Inteligencia Artificial

Dado el volumen y la naturaleza abierta de las respuestas, en esta sección no se presenta un análisis exhaustivo caso por caso, sino una síntesis temática que permite ilustrar las ideas más recurrentes expresadas por el alumnado. Para ello, se empleó una técnica de análisis asistido, en la que las respuestas fueron introducidas en ChatGPT mediante el siguiente prompt: “Resumir las respuestas en temas o categorías principales.” Siguiendo el enfoque metodológico propuesto por Tight (2015), el objetivo del análisis fue identificar palabras clave y temas centrales con el fin de revelar diversas perspectivas estudiantiles. En lugar de aplicar categorías predefinidas, este enfoque fenomenográfico permite que los temas emerjan directamente de los datos, reflejando la variedad de puntos de vista. Esta estrategia, alineada con enfoques exploratorios y de categorización inicial en estudios cualitativos (Braun & Clarke, 2006), permitió agrupar los comentarios en torno a los temas más representativos, lo cual facilita su interpretación y presentación. Cabe señalar que este procedimiento constituye una primera aproximación exploratoria al contenido cualitativo, útil para identificar patrones generales, aunque no sustituye un análisis cualitativo en profundidad. A continuación, se ofrece un resumen organizado por categorías emergentes. A continuación, se ofrece un resumen organizado por categorías emergentes. Las reflexiones de los estudiantes fueron analizadas mediante un proceso de categorización temática orientado a identificar las diferentes formas cualitativas en que comprenden la relación entre herramientas de IA como ChatGPT y la integridad académica.

En respuesta a la primera pregunta, ¿Tienes pensado hacer algún curso sobre IA?, se recogieron 140 respuestas: 106 personas (75,7%) indicaron que no tenían planes de realizar un curso sobre IA, mientras que 34 (24,3%) expresaron su intención de hacerlo en el futuro. Esta categorización básica, de tipo cuantitativo-descriptivo, se empleó únicamente como una primera aproximación para ilustrar la tendencia general del alumnado respecto a su interés formativo en IA.

Respecto a la segunda pregunta “¿Qué te gustaría aprender en otro taller sobre IA?”. Se recogieron 109 respuestas cuyas ideas se resumen en la Tabla 5.

Tabla 5 Categorías de respuesta a la pregunta “¿Qué te gustaría aprender en otro taller sobre IA?”.

| Categorías | Ejemplos de respuestas |

|---|---|

| 1. Cómo usar mejor la IA | • Cómo preguntar mejor a la IA • Cómo estructurar preguntas para obtener mejores respuestas • Técnicas para aprovechar la IA académica y profesionalmente • Usarla de manera más beneficiosa, adecuada y correcta • Aprender a utilizarla correctamente en el día a día y en los estudios |

| 2. Uso ético y responsable | • Uso ético de la IA • Protección de datos personales • Impacto medioambiental y psicológico de la IA • Evitar la dependencia de la IA |

| 3. Fiabilidad y verificación | • Cómo saber si una respuesta de IA es verdadera o confiable • Contrastar y comprobar información • Detección de errores en las respuestas de IA |

| 4. Funcionamiento interno de la IA | • Cómo procesa la información • Cómo fue creada y su evolución • Automatización de respuestas • Manejo de datos |

| 5. Herramientas y plataformas | • Otras IAs además de ChatGPT • Herramientas emergentes como Suno para crear videos • Plataformas específicas según cada necesidad |

| 6. Aplicaciones específicas | • Aplicaciones en trabajo social • Uso académico • Organización de estudios • Futuro uso profesional |

| 7. Creatividad y expansión | • Creación de imágenes • Diversos usos menos conocidos • Futuros distópicos o utópicos relacionados con IA |

Fuente: Elaboración propia.

Discusión

Distintos centros educativos y de investigación han publicado guías institucionales con recomendaciones de uso de la IA para educación, pero aún existe una brecha entre la normativa disponible y la alfabetización ética entre la comunidad universitaria (Chen et al., 2024, 2025). Este trabajo responde a la necesidad creciente de formar al alumnado universitario en el uso responsable de la IAG, en un contexto académico y profesional cada vez más influido por esta tecnología (Abdelwahab et al., 2023). Tal y como han señalado investigaciones recientes, el desarrollo de competencias digitales y éticas vinculadas a la IA resulta esencial para preparar a las futuras generaciones ante los retos de la era digital (Luckin et al., 2022; Holmes et al., 2019).

Con este propósito, el estudio tuvo tres objetivos principales: (1) presentar el diseño de un taller sobre uso responsable de la IA dirigido al alumnado universitario; (2) evaluar la satisfacción de los participantes con dicha formación; y (3) analizar el interés por recibir formación futura sobre IA. En relación con el primer objetivo, el taller se diseñó con un enfoque aplicado y participativo, combinando contenidos teóricos con dinámicas prácticas como debates, encuestas en directo o actividades grupales. Esta estructura permitió abordar tanto los aspectos técnicos como los dilemas éticos asociados a la IA, promoviendo una reflexión crítica sobre su impacto en el aprendizaje y en el futuro profesional del alumnado. La descripción detallada del taller constituye una aportación relevante, ya que muchas intervenciones previas no explicitan sus contenidos ni metodologías, dificultando su replicabilidad.

Respecto al segundo objetivo, los resultados muestran una satisfacción muy alta por parte del alumnado, con puntuaciones medias cercanas al valor máximo en todos los ítems evaluados. Por una parte, valoran positivamente la claridad de los objetivos y la presentación de los contenidos, la utilidad y la estructura del material de apoyo y las actividades realizadas. La gran mayoría considera que el taller fomentó la participación y el intercambio de ideas. También se valora positivamente la duración del taller y los resultados muestran una alta satisfacción general. La gran mayoría recomendaría el taller a otros/as estudiantes.

En cuanto al tercer objetivo, el análisis cualitativo reveló un interés creciente por aprender a utilizar mejor la IAG, especialmente desde una perspectiva ética, práctica y adaptada a cada ámbito profesional. A pesar de que una parte del alumnado no planea formarse aún en IAG, muchos identifican competencias clave para la era digital como el pensamiento crítico, la creatividad, la responsabilidad y la capacidad de adaptación.

Implicaciones teóricas y practicas

El presente trabajo aporta implicaciones relevantes para la educación superior y la alfabetización ética en IAG. En primer lugar, destaca la necesidad de desarrollar actividades que integren la alfabetización digital crítica y la formación ética como dimensiones inseparables ante la expansión de la IAG en contextos académicos (Luckin et al., 2022; Holmes et al., 2019). La investigación apoya la idea de que la existencia de normativas institucionales no garantiza por sí sola una comprensión profunda ni un uso ético de la tecnología por parte del alumnado, en línea con los hallazgos de Bergström et al. (2024) y Chen et al. (2024, 2025). Además, los resultados empíricos obtenidos refuerzan teorías que subrayan la eficacia de las intervenciones participativas y reflexivas para fomentar el pensamiento crítico y la integridad académica (Usher & Barak, 2024). Así, este estudio contribuye a la literatura al mostrar que la integración activa de la ética en los procesos de alfabetización digital es clave para afrontar los desafíos de la IAG y promover una cultura institucional basada en la responsabilidad y la reflexión.

En cuanto a las implicaciones prácticas, la valoración positiva del taller por parte del alumnado respalda su utilidad como vía formativa para fomentar un uso responsable de la IA en la universidad. Estos resultados invitan a ampliar su aplicación a otros grados, programas de posgrado e incluso al conjunto del alumnado universitario. No obstante, su implementación sostenible exige superar ciertos retos, como asegurar su integración en los planes de estudio. En este caso, el hecho de impartir el taller en horario lectivo facilitó una participación elevada, lo que indica que será necesario encontrar fórmulas que permitan su incorporación efectiva en la estructura curricular. En este sentido, se propone su integración transversal como parte de la formación en ciudadanía digital (Ansari et al., 2024).

El taller fue percibido como dinámico, informativo y necesario, y el alumnado expresó su agradecimiento por este tipo de iniciativas. Las respuestas cualitativas también mostraron interés por aprender a usar la IA de manera ética, crítica y adaptada a contextos profesionales, lo que refuerza la necesidad de diseñar formaciones que combinen aspectos técnicos con marcos éticos y reflexivos.

Más allá de los talleres para el estudiantado, se requieren estrategias institucionales más amplias. Estas deberían incluir acciones paralelas dirigidas al profesorado y otros miembros de la comunidad universitaria, de modo que exista coherencia entre las expectativas formativas y las prácticas docentes. Muchos docentes expresan incertidumbre respecto al uso de herramientas de IAG y a los marcos institucionales vigentes, lo que limita su capacidad de orientación (Chen et al., 2025). Diseñar formaciones específicas para el profesorado ayudaría a alinear los valores promovidos con las prácticas reales.

Además, los talleres pueden convertirse en espacios de diálogo sobre normas, valores y dilemas relacionados con la IAG. Para que tengan un impacto duradero, deben formar parte de una estrategia institucional coherente que incluya directrices claras y prácticas sobre el uso de la IAG en el contexto académico. La confianza institucional es fundamental: cuando las normas son vagas o ambiguas, el alumnado puede explorar zonas grises o justificar usos inapropiados (Cotton, 2023). Por tanto, el desarrollo e implementación de directrices claras debe ir acompañado de su difusión efectiva y de orientaciones prácticas comprensibles para toda la comunidad universitaria. En este proceso, los talleres pueden desempeñar un papel clave no solo como espacios de formación, sino también como vehículos para la apropiación y diseminación de dichas directrices.

Limitaciones y futuras investigaciones

Este trabajo presenta varias limitaciones que deben considerarse al interpretar sus resultados. La muestra se limita a estudiantes de una única universidad, lo que restringe la generalización de los hallazgos. Además, la evaluación de la intervención se basa en la autopercepción del alumnado, sin un grupo de control ni una medición a largo plazo de los cambios en el comportamiento. Asimismo, el enfoque cualitativo empleado para analizar el interés formativo puede introducir sesgos interpretativos. Futuros estudios deberán analizar los efectos del taller no solo en el uso ético y responsable, sino también en la prevalencia de conductas deshonestas como el plagio en el campus universitario, tanto a corto como a largo plazo (Muñoz-Cantero et al., 2021). Desde una perspectiva metodológica, la evaluación de los talleres puede basarse en modelos de cambio actitudinal y aprendizaje transformativo. Estudios previos han empleado pretest y postest, análisis cualitativos de portafolios reflexivos y escalas de autoeficacia ética para valorar su impacto (Bergström et al., 2024). Experiencias formativas llevadas a cabo en el ámbito universitario muestran que intervenciones breves pero intensivas sobre el uso responsable de la IA pueden modificar no solo conocimientos, sino también actitudes y prácticas sostenidas en el tiempo (Villajos & Soriano, 2024). Por tanto, futuras investigaciones deben abordar estos aspectos para fortalecer la validez y el alcance de las conclusiones.

Conclusiones

Desde asistentes virtuales como ChatGPT hasta sistemas de análisis de datos y personalización del aprendizaje, la IA está redefiniendo las dinámicas académicas. A medida que el alumnado adopte herramientas de IA, estas tecnologías transformarán la forma en que acceden a la información, realizan tareas y se resuelven problemas. Sin embargo, la aceptación de una herramienta no implica necesariamente su uso responsable. El alumnado se encuentra ante una situación donde, aunque el uso de la IA es cada vez más común, aún no existe una formación lo suficientemente clara. Sin una formación adecuada, el alumnado puede caer en la tentación de usar la IA para realizar tareas que van en contra de la integridad académica, ya sea por ignorancia de las normas o por una falta de reflexión ética sobre el impacto de sus acciones. En este contexto, la necesidad de formaciones específicas en IA se vuelve crucial para preparar a los estudiantes para aprovechar estas herramientas de manera ética y efectiva.

Por todas estas razones, es esencial que las universidades implementen talleres de formación en IA que aborden estos puntos clave. Estos talleres deben proporcionar al alumnado una comprensión integral de las tecnologías de IA, sus oportunidades y riesgos, y promover una reflexión ética sobre su uso, fomentando la integridad académica. La formación en IA debe ser vista no solo como una herramienta pedagógica, sino como una preparación esencial para el futuro profesional del alumnado, garantizando que puedan desenvolverse con responsabilidad en el entorno académico y laboral que la IA está configurando. Los resultados obtenidos respaldan la necesidad de que las universidades implementen medidas como talleres interactivos y evaluados para promover el uso ético y responsable de la IA, contribuyendo así a una formación más integral y adaptada a los desafíos del entorno digital contemporáneo.